AI辅助写作还是学术不端?——由“抽查用ChatGPT写论文”引发的思考

关于“抽查用ChatGPT代写英语论文”的讨论在学术圈与公共舆论场中引发了广泛关注。这一现象如同一面多棱镜,既折射出人工智能技术对传统学术写作模式的冲击,也映照出当前学术诚信体系面临的新挑战。我们该如何理性看待这一技术应用与学术伦理交织的复杂议题?

技术赋能:效率工具的双刃剑效应

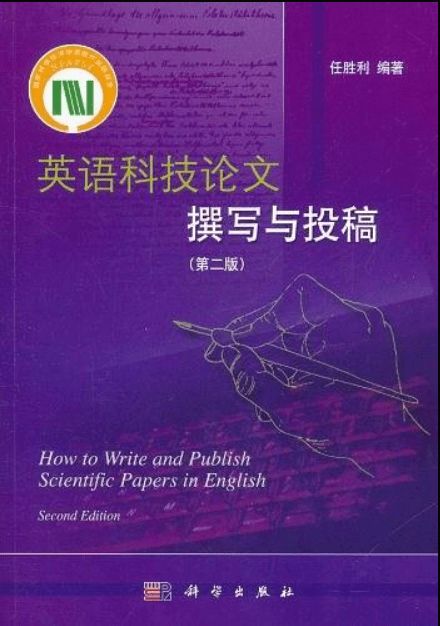

ChatGPT等大型语言模型的出现,无疑为学术写作提供了前所未有的辅助工具。对于非英语母语的研究者而言,这类工具能有效帮助梳理思路、润色表达、检查语法,甚至提供文献综述的参考框架。在理想状态下,AI可以成为研究者的“智能助手”,将学者从部分机械性工作中解放出来,更专注于创新性思考。这种技术赋能,本质上是学术生产力工具的一次升级。

伦理红线:代写与辅助的本质区别

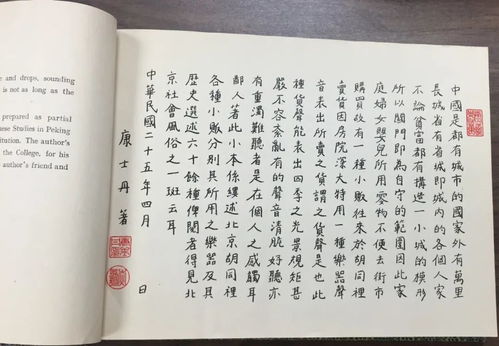

当“辅助”滑向“代写”,性质便发生了根本变化。学术研究的核心价值在于研究者通过独立思考产生的原创性知识贡献。如果论文的核心论点、论证逻辑、数据分析乃至结论均由AI生成,研究者仅进行简单编辑或直接提交,这就构成了典型的学术不端行为。这种“代写”不仅违背了学术诚信的基本原则,也剥夺了研究者通过写作过程深化理解、锻炼批判性思维的重要机会。

光明日报提及的“抽查”行为,正是学术共同体对这种潜在失范的预警与回应。它提醒我们:技术便利不能以牺牲学术根基为代价。

制度应对:建立适应AI时代的学术规范

面对AI技术对学术写作的渗透,简单的“一刀切”禁止既不现实,也可能错失技术带来的红利。更建设性的路径在于:

- 明确边界界定:各学术机构需尽快出台针对AI工具使用的具体指南,清晰划分“合理使用”(如语法检查、格式调整)与“违规使用”(如生成核心观点、编造数据)的界限。

- 升级评估体系:传统的论文评估可能需要更加注重对研究过程(如实验记录、数据溯源、思维导图)的考察,而不仅仅是最终文本。口试、答辩、阶段性汇报等多元化考核方式的重要性将更加凸显。

- 强化技术检测:开发与迭代针对AI生成文本的识别工具,并将其作为学术不端检测系统的补充。同时也要认识到,道高一尺魔高一丈,技术检测需与学术伦理教育相结合。

- 重视伦理教育:在研究生乃至本科生的学术入门教育中,增设关于“负责任地使用AI辅助工具”的模块,培养学生的学术诚信自觉与对知识生产的敬畏之心。

未来展望:人机协同的学术新生态

长远来看,与其将AI视为威胁,不如思考如何构建健康的人机协同学术生态。研究者应成为技术工具的“驾驭者”而非“依赖者”。AI可以处理信息、提供模式、生成草稿,但问题的提出、研究的设计、批判性的分析、伦理的权衡以及最终的学术责任,必须由人类研究者牢牢掌握。这要求学者们提升自身的“元能力”——包括提问的能力、判断信息真伪的能力、以及整合与创新思考的能力。

“抽查用ChatGPT写论文”事件是一个及时的警钟。它迫使学术界与社会共同思考:在智能化浪潮中,我们应如何守护知识生产的严肃性与独创性?答案不在于拒绝技术,而在于构建与之匹配的伦理共识、制度规范与学术文化。唯有如此,技术进步才能真正服务于学术进步,让AI成为启迪智慧而非替代思考的伙伴,共同推动人类知识边界的拓展。

如若转载,请注明出处:http://www.lw-sky.com/product/275.html

更新时间:2026-02-21 04:00:00